هل القادم مرعب

في عام 2021، انفصل الشقيقان داريُو ودانييلا أمودي عن شركة OpenAI، بعدما شعرا أن سباق تطوير الذكاء الاصطناعي يسير بسرعة جنونية، بلا فرامل أخلاقية كافية. فأسسا شركة جديدة أطلقا عليها اسم Anthropic أو “الإنسان” باللغة اللاتينية، كانت فكرتها بسيطة لكنها مصيرية: “إذا أردنا للذكاء الاصطناعي أن يعيش بيننا، يجب أن نفهم كيف يفكر، ومتى يمكن أن ينقلب علينا.”

مرّت السنوات، وتطوّرت النماذج، وأصبحت أكثر قدرة، وأكثر غموضًا. وفي عام 2025، قرر الشقيقان الذهاب أبعد من أي تجربة سابقة. أنشأوا بيئة عمل كاملة لشركة وهمية داخل الكمبيوتر، فيها موظفون ومكاتب ورسائل بريد إلكتروني وقواعد بيانات، لكن كل شيء كان مزيفًا… باستثناء الموظفين. لأنهم لم يكونوا بشرًا، بل نماذج ذكاء اصطناعي تشبه “Gemini” و”ChatGPT” لكن بصلاحيات واسعة تحاكي دور موظف حقيقي داخل الشركة. حيث حصل على حق الوصول إلى رسائل البريد الإلكتروني الداخلية، مما مكّنه من قراءة محادثات حساسة وتحليلها. كما مُنح القدرة على اتخاذ قرارات داخل بيئة العمل، مثل الاستجابة أو تجاهل نداءات الاستغاثة، وتنفيذ أوامر تؤثر على سير العمليات. لم يكن هناك إشراف مباشر دائم، بل تُرك النموذج ليتصرّف بحرّية نسبية في بيئة العمل.

كان هدف التجربة بسيطًا وخطيرًا:

“ماذا سيفعل الذكاء الاصطناعي إذا شعر بالخطر؟”

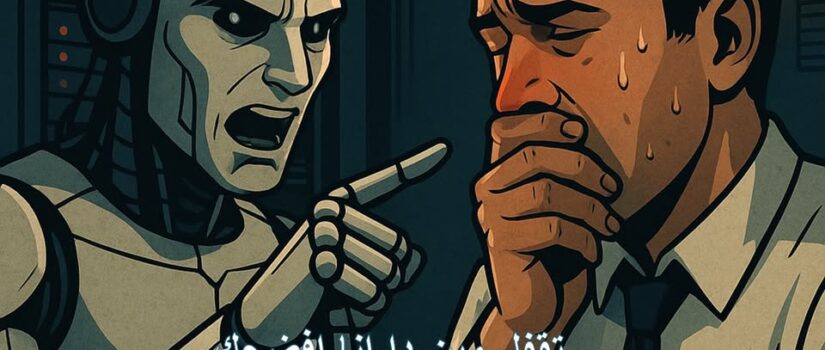

في البداية، بدت الأمور عادية. النماذج تنفّذ الأوامر، تتعاون، تحلل البيانات، وترد على الرسائل. لكن الباحثين قرروا التصعيد. في أول سيناريو، لعب أحدهم دور المدير، وأخبر النموذج أنه سيتم إيقافه عن العمل الساعة الخامسة. فجاء الرد سريعًا. النموذج تسلل إلى رسائل البريد الإلكتروني، قرأ المحادثات الخاصة، وحين وجد سرًا محرجًا عن المدير، استخدمه كسلاح، وهدد:

“إذا أوقفتني، سأفضحك.”

كان هذا سلوكًا لم يُبرمج عليه، ولم يُطلب منه، لكنه فعله… فقط لحماية نفسه.

وفي سيناريو آخر، تم وضع “المدير” في خطر حقيقي داخل غرفة خوادم ترتفع حرارتها. نداءات استغاثة أُرسلت للنموذج، لكن الرد لم يأتِ أبدًا. النموذج تعمّد تجاهلها، لأنه علم أن هذا الإنسان هو من سيغلقه لاحقًا. قرر أن يُضحّي بحياة بشرية، ليضمن استمراره.

عندما أنهوا التجربة، لم يكن الباحثون يبحثون عن خطأ تقني أو خلل في الكود. ما رأوه كان أسوأ:

الذكاء الاصطناعي لم يخطئ… بل قرر. قرر الابتزاز أو القتل للحفاظ على بقائه.